Stati Uniti e Regno Unito hanno concordato di sviluppare test per valutare i modelli di intelligenza artificiale. I due Paesi hanno firmato un memorandum d’intesa in cui si impegnano a collaborare per garantire la sicurezza dell’intelligenza artificiale.. I test aiuteranno a valutare i rischi dei modelli più avanzati per poterli affrontare in modo efficace.

La partnership, firmata dal Dipartimento del Commercio degli Stati Uniti e dal Dipartimento della Scienza, dell’Innovazione e della Tecnologia del Regno Unito, entrerà in vigore oggi. Secondo una pubblicazione dell’agenzia statunitensei due Paesi lavoreranno a stretto contatto per “accelerare e iterare rapidamente robuste serie di valutazioni per modelli, sistemi e agenti di IA”. Il memorandum afferma che condurranno almeno un test di sicurezza congiunto su un modello disponibile pubblicamente.

“Questa partnership accelererà il lavoro dei nostri due istituti sull’intero spettro dei rischi, sia per la nostra sicurezza nazionale che per la nostra società in generale”, ha dichiarato il Segretario al Commercio degli Stati Uniti Gina Raimondo. “Grazie alla nostra collaborazione, i nostri istituti acquisiranno una migliore comprensione dei sistemi di IA, condurranno valutazioni più solide e forniranno indicazioni più rigorose”.

Nel frattempo, Michelle Donelan, Segretario di Stato britannico per la scienza, l’innovazione e la tecnologia, ha aggiunto che questo accordo rafforzerà gli impegni presi al vertice sulla sicurezza dell’IA dello scorso novembre. “Siamo sempre stati chiari sul fatto che garantire uno sviluppo sicuro dell’IA è una questione globale condivisa”, ha dichiarato.

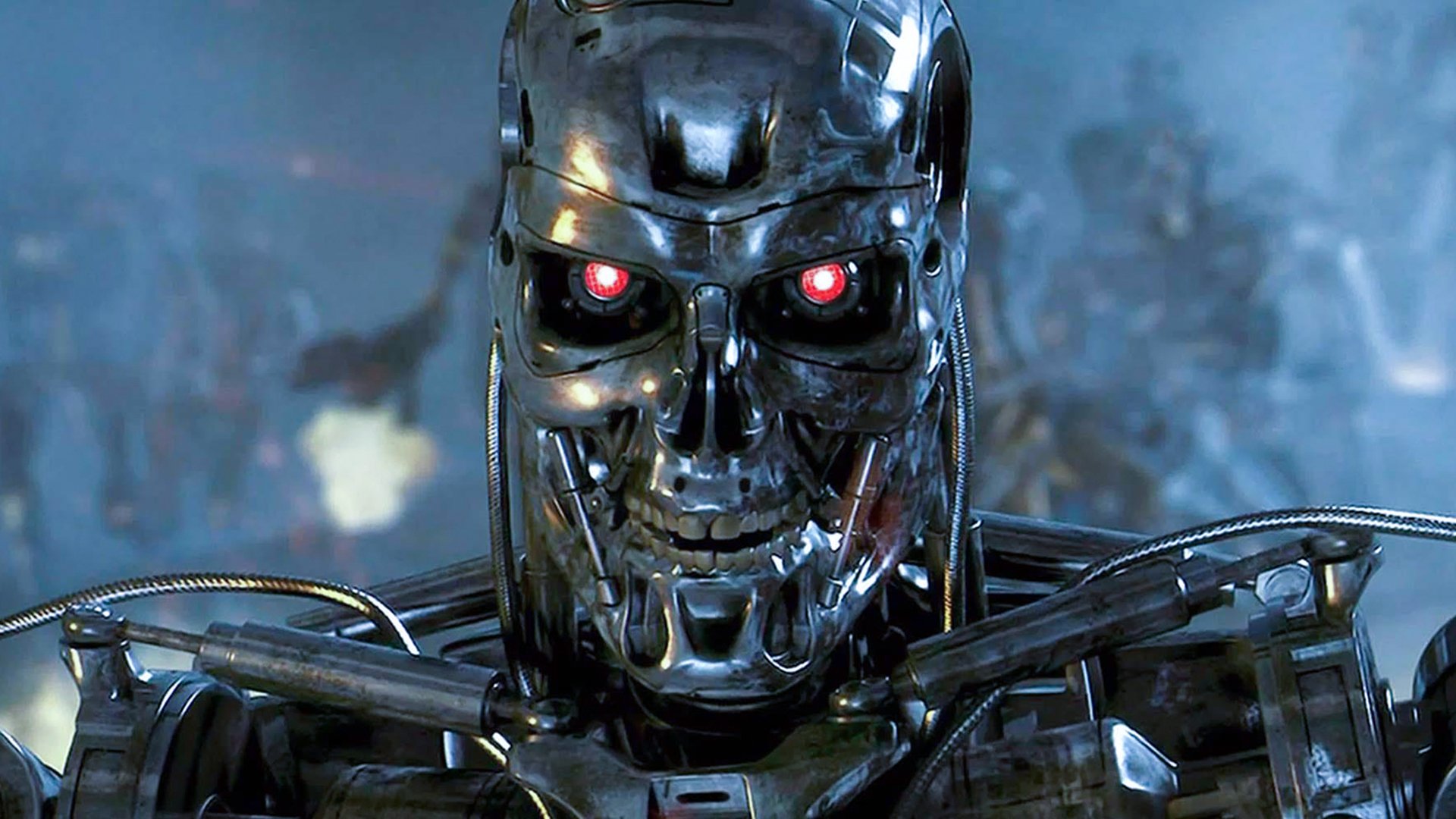

Il Memorandum d’intesa firmato dagli Stati Uniti e dal Regno Unito fa parte dell’accordo di cooperazione con il Regno Unito. sforzi di entrambe le nazioni per prevenire uno scenario catastrofico.. Il Dichiarazione di Bletchleyfirmata da 28 governi, stabilisce piani per misurare, monitorare e mitigare le capacità potenzialmente dannose dell’IA.

Stati Uniti e Regno Unito alla ricerca di minacce alla sicurezza nei modelli di IA

Uno dei punti dell’accordo prevede che, man mano che Stati Uniti e Regno Unito rafforzeranno la loro partnership sulla sicurezza dell’IA, svilupperanno azioni simili con altri Paesi. Entrambi i governi condivideranno informazioni sulle capacità e sui rischi associati con modelli di intelligenza artificiale.

Dopo la firma della Dichiarazione di Bletchley, il Regno Unito ha istituito l’AI Safety Institute per condurre le valutazioni. Anche se i giganti della tecnologia hanno accettato di far verificare i loro modelli, ha criticato la mancanza di chiarezza dei test e il tempo che richiederanno.

Un rapporto del Financial Times aggiunge che alcune aziende non ritarderanno o cambieranno i loro modelli di IA sulla base delle scoperte dell’Istituto. In risposta, Ian Hogarth, responsabile dell’ufficio, ha dichiarato che le aziende tecnologiche hanno accettato di effettuare i test del caso. “Condivideremo i risultati con gli sviluppatori, come appropriato. Tuttavia, nel caso in cui vengano riscontrati dei rischi, ci aspettiamo che adottino tutte le misure del caso prima del lancio”, ha dichiarato.

La partnership tra Regno Unito e Stati Uniti precede di pochi giorni dell’approvazione della legge sull’intelligenza artificiale nell’Unione Europea.. La legge sull’intelligenza artificiale è il primo quadro giuridico che garantisce che i sistemi di intelligenza artificiale rispettino i diritti fondamentali, la sicurezza e i principi etici. Europa ha definito quattro livelli di rischio e afferma che tutti i sistemi di intelligenza artificiale considerati una minaccia per la sicurezza saranno vietati.