Il Guardian ha accusato Microsoft di aver danneggiato la sua reputazione giornalistica con un sondaggio generato dall’intelligenza artificiale. L’azienda tecnologica ha inserito un sondaggio automatico accanto a una notizia che riportava la morte di una donna. Il sondaggio chiedeva agli utenti la possibile causa della morte, che ha generato un’immediata reazione da parte dei lettori.

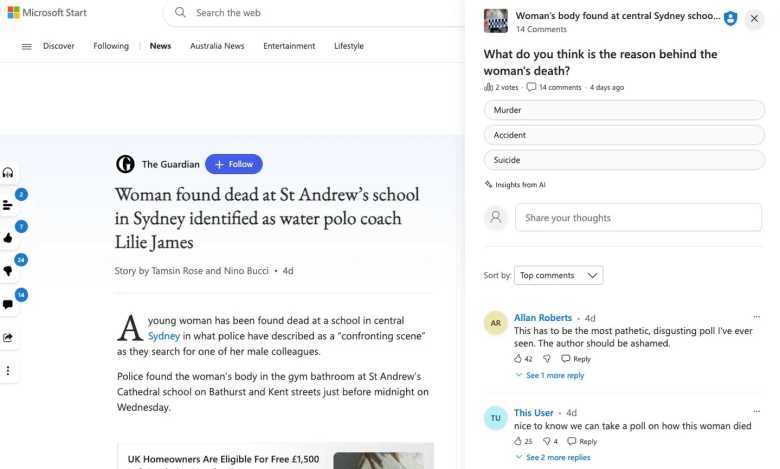

Il sondaggio, intitolato “Prospettive da AI”, è stato diffuso insieme all’articolo del Guardian in L’aggregatore di notizie di Microsoft. Il rapporto menziona che la polizia di Sydney ha trovato il corpo di una donna nella toilette di una scuola. Microsoft AI ha pubblicato un sondaggio con la domanda “Quale pensate sia il movente della morte della donna?”, con tre risposte: omicidio, incidente e suicidio.

Secondo Il Guardianlettori hanno reagito con rabbia e hanno concluso che il sondaggio era opera del giornale e non di un’intelligenza artificiale. “Questo è il sondaggio più patetico e disgustoso che abbia mai visto. L’autore dovrebbe vergognarsi”, ha dichiarato uno di loro. I commenti di rifiuto sono rimasti online fino a poche ore fa sul sito web di Microsoft Start.

Anna Bateson, amministratore delegato del Guardian Media Group, ha dichiarato che l’incidente ha causato un danno significativo alla reputazione dei media e dei giornalisti che hanno scritto la storia. Bateson ha inviato una lettera a Brad Smith, presidente di Microsoft, chiedendo di garantire che una situazione simile non si ripeta.

Microsoft deve assumersi la responsabilità della sua IA

The Guardian ha chiesto a Microsoft di non utilizzare la tecnologia sperimentale in combinazione con i suoi contenuti senza previa autorizzazione.

“Questa applicazione dell’IA generativa da parte di Microsoft è esattamente il tipo di caso da cui abbiamo messo in guardia in relazione alle notizie”, ha detto Bates. “Ed è uno dei motivi principali per cui abbiamo chiesto ai loro team di non volere che le tecnologie sperimentali di Microsoft vengano applicate al giornalismo autorizzato del Guardian”, ha aggiunto.

I media hanno chiesto a Microsoft di aggiungere una nota all’articolo , assumendosi la responsabilità dei danni causati dal sondaggio. “Si prega di notare i commenti dei lettori che chiaramente non sanno che è stata Microsoft a creare questo sondaggio, non il Guardian”, ha detto Bates. L’autrice ha affermato che è giunto il momento per le aziende di fornire maggiore trasparenza e certezza su “tecnologie altamente imprevedibili” come l’intelligenza artificiale.

Vale la pena notare che questo non è la prima volta che l’intelligenza artificiale di Microsoft commette un errore. di questo tipo. Qualche mese fa, un articolo scritto da un’AI generativa ha inserito il Banco alimentare di Ottawa tra le prime tre destinazioni turistiche della città. “Se decidete di visitarla, considerate di andarci a stomaco vuoto”, si legge nella descrizione.

Il Gli articoli di MSN sono generati dall’intelligenza artificiale dal 2020, dopo che Microsoft ha licenziato tutto il suo staff di redattori e giornalisti. Microsoft News fa parte della divisione Bing e la selezione delle notizie si basa su algoritmi. Altri media hanno seguito questa strada, come Gizmodoche alla fine di agosto è diventato un sito web per le traduzioni generate dall’intelligenza artificiale..